Przez

Chcąc wyszkolić roboty do wykonywania zadań w świecie rzeczywistym, badacze stworzyli „Holodeck” – system sztucznej inteligencji zdolny do generowania na żądanie szczegółowych, konfigurowalnych środowisk 3D, inspirowany technologią holodeku ze Star Trek. System ten wykorzystuje duże modele językowe do interpretowania żądań użytkowników i generowania szerokiej gamy scenariuszy wnętrz, pomagając robotom uczyć się efektywniejszego poruszania się w nowych przestrzeniach. (Koncepcja artysty.) Źródło: SciTechDaily.com

Naukowcy z Uniwersytetu Pensylwanii i AI2 opracowali „Holodeck” – zaawansowany system zdolny do generowania szerokiej gamy środowisk wirtualnych do szkolenia agentów AI.

W Star Trek: Następne pokolenie Kapitan Picard i załoga USS Enterprise wykorzystują holodeck, puste pomieszczenie zdolne do generowania trójwymiarowych środowisk, do przygotowywania misji i rozrywki. Technologia ta symuluje wszystko, od bujnej dżungli po Londyn Sherlocka Holmesa. Te głęboko wciągające i w pełni interaktywne środowiska można dowolnie dostosowywać; załoga po prostu żąda od komputera określonego ustawienia, które materializuje się w holodeku.

Obecnie wirtualne, interaktywne środowiska wykorzystuje się także do szkolenia robotów przed ich wdrożeniem w świecie rzeczywistym w procesie zwanym „Sim2Real”. Jednakże, ilość wirtualnych interaktywnych środowisk jest zaskakująco mała. „Artyści ręcznie tworzą takie środowiska” – mówi Yue Yang, doktorantka w laboratoriach Marka Yatskara i Chrisa Callison-Burcha, profesorów adiunktów i profesorów nadzwyczajnych w dziedzinie informatyki i informatyki (CIS). „Ci artyści mogliby spędzić tydzień, budując jedno środowisko” – dodaje Yang, odnotowując wszystkie związane z tym decyzje, od układu przestrzeni, przez rozmieszczenie obiektów, po kolory użyte do renderowania.

Wyzwania w tworzeniu wirtualnych środowisk szkoleniowych

Niedobór środowisk wirtualnych stanowi problem, jeśli chcesz wyszkolić roboty do poruszania się po prawdziwym świecie ze wszystkimi jego złożonościami. Sieci neuronowe, czyli systemy napędzające dzisiejszą rewolucję AI, wymagają ogromnych ilości danych, co w tym przypadku oznacza symulacje świata fizycznego. „Generatywne systemy sztucznej inteligencji, takie jak ChatGPT, są szkolone na bilionach słów, a generatory obrazów, takie jak Midjourney i DALLE, są szkolone na miliardach obrazów” – mówi Callison-Burch. „Mamy tylko ułamek tej liczby środowisk 3D do szkolenia tak zwanej „ucieleśnionej sztucznej inteligencji”. Jeśli chcemy wykorzystać generatywne techniki sztucznej inteligencji do opracowania robotów, które będą mogły bezpiecznie poruszać się w rzeczywistych środowiskach, będziemy musieli stworzyć miliony lub miliardy symulowanych środowisk”.

Używając języka potocznego, użytkownicy mogą podpowiedzieć Holodeckowi wygenerowanie praktycznie nieskończonej różnorodności przestrzeni 3D, co stwarza nowe możliwości szkolenia robotów w zakresie poruszania się po świecie. Źródło: Yue Yang

Wchodzić Holodeksystem generowania interaktywnych środowisk 3D współtworzony przez Callison-Burch, Yatskar, Yang i Lingjie Liu, Aravind K. Joshi adiunkt w CIS wraz ze współpracownikami ze Stanford, The uniwersytet Waszyngtońskioraz Instytut Sztucznej Inteligencji Allena (AI2). Nazwany na cześć swojego poprzednika ze Star Trek, Holodeck generuje praktycznie nieograniczoną gamę środowisk wewnętrznych, wykorzystując sztuczną inteligencję do interpretowania żądań użytkowników. „Możemy kontrolować to za pomocą języka” – mówi Yang. „Możesz łatwo opisać dowolne środowiska i wyszkolić wcielonych agentów AI”.

Holodeck wykorzystuje wiedzę zawartą w dużych modelach językowych (LLM), systemach leżących u podstaw ChatGPT i innych chatbotach. „Język jest bardzo zwięzłą reprezentacją całego świata” – mówi Yang. Rzeczywiście, studenci LLM okazują się mieć zaskakująco wysoki poziom wiedzy na temat projektowania przestrzeni, dzięki ogromnej ilości tekstu, który przyswajają podczas szkoleń. Zasadniczo Holodeck działa poprzez angażowanie LLM w rozmowę, wykorzystując starannie uporządkowaną serię ukrytych zapytań w celu podzielenia żądań użytkowników na określone parametry.

Zastosowanie i testowanie holodeku w świecie rzeczywistym

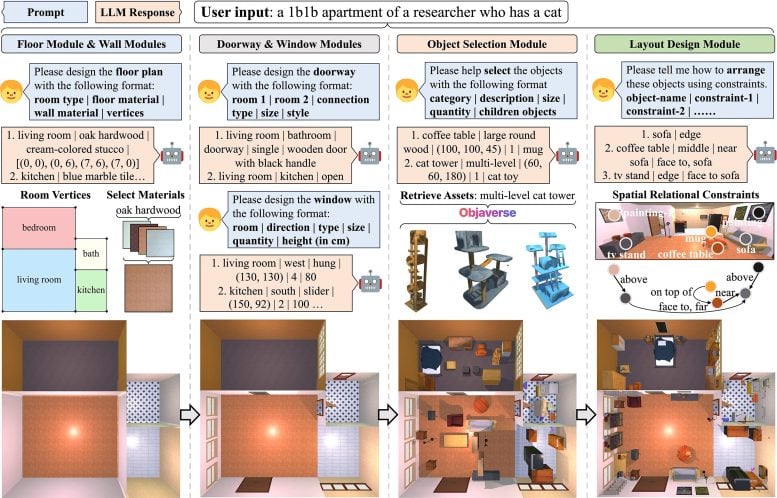

Podobnie jak Kapitan Picard może poprosić Holodeck ze Star Trek o symulację lokalu, tak badacze mogą poprosić Holodeck Penna o stworzenie „mieszkania 1b1b dla badacza, który ma kota”. System realizuje to zapytanie, dzieląc je na kilka etapów: najpierw tworzona jest podłoga i ściany, następnie drzwi i okna. Następnie Holodeck przeszukuje Objaverse, ogromną bibliotekę gotowych obiektów cyfrowych, w poszukiwaniu mebli, jakich można się spodziewać w takiej przestrzeni: stolika kawowego, wieży dla kota i tak dalej. Na koniec Holodeck pyta o moduł układu, który badacze zaprojektowali w celu ograniczenia rozmieszczenia obiektów, tak aby toaleta nie wystawała poziomo ze ściany.

Zasadniczo Holodeck wykorzystuje w rozmowie duży model językowy (LLM), budując środowisko wirtualne kawałek po kawałku. Źródło: Yue Yang

Aby ocenić możliwości Holodecka pod kątem ich realizmu i dokładnośćbadacze wygenerowali 120 scen przy użyciu Holodeck i ProcTHOR, wcześniejszego narzędzia stworzonego przez AI2, i poprosili kilkuset studentów Penn Engineering o wskazanie preferowanej wersji, nie wiedząc, które sceny zostały utworzone za pomocą jakich narzędzi. Dla każdego kryterium — wyboru zasobów, spójności układu i ogólnych preferencji — uczniowie konsekwentnie oceniali środowiska generowane przez Holodeck bardziej przychylnie.

Naukowcy przetestowali także zdolność Holodecka do generowania scen, które są mniej typowe w badaniach nad robotyką i trudniejsze do ręcznego stworzenia niż wnętrza mieszkań, takie jak sklepy, przestrzenie publiczne i biura. Porównując wyniki programu Holodeck z wynikami programu ProcTHOR, które zostały wygenerowane przy użyciu reguł stworzonych przez człowieka, a nie tekstu wygenerowanego przez sztuczną inteligencję, badacze po raz kolejny odkryli, że osoby oceniające wolały sceny stworzone przez Holodeck. Ta preferencja dotyczy szerokiej gamy środowisk wewnętrznych, od laboratoriów naukowych po pracownie artystyczne, szatnie i piwnice z winami.

Na koniec badacze wykorzystali sceny wygenerowane przez Holodeck, aby „dostroić” ucieleśnionego agenta AI. „Ostatecznym testem Holodeck” – mówi Yatskar – „polega na użyciu go, aby pomóc robotom w bezpieczniejszej interakcji z otoczeniem, przygotowując je do zamieszkania w miejscach, w których nigdy wcześniej nie były”.

W wielu typach przestrzeni wirtualnych, w tym w biurach, przedszkolach, salach gimnastycznych i salonach gier, Holodeck miał wyraźny i pozytywny wpływ na zdolność agenta do poruszania się po nowych przestrzeniach.

Na przykład, podczas gdy agentowi udało się znaleźć pianino w pokoju muzycznym tylko w około 6% przypadków po wstępnym przeszkoleniu przy użyciu ProcTHOR (co wymagało wykonania przez agenta około 400 milionów wirtualnych kroków), agentowi udało się to w ponad 30% przypadków, gdy dostrojone przy użyciu 100 pokoi muzycznych generowanych przez Holodeck.

„W tej dziedzinie od dawna utknęliśmy, prowadząc badania w przestrzeniach mieszkalnych” – mówi Yang. „Ale istnieje tak wiele różnorodnych środowisk — wydajne generowanie wielu środowisk do szkolenia robotów zawsze było dużym wyzwaniem, ale Holodeck zapewnia tę funkcjonalność”.

Odniesienie: „Holodeck: generowanie 3D ucieleśnionych sztucznej inteligencji za pomocą języka” autorstwa Yue Yang, Fan-Yun Sun, Luca Weihs, Eli VanderBilt, Alvaro Herrasti, Winson Han, Jiajun Wu, Nick Haber, Ranjay Krishna, Lingjie Liu, Chris Callison- Burch, Mark Yatskar, Aniruddha Kembhavi i Christopher Clark, 22 kwietnia 2024, arXiv.

DOI: 10.48550/arXiv.2312.09067

Badacze zaprezentowali Holodeck na 2024 Instytut Inżynierów Elektryków i Elektroników (IEEE) oraz Computer Vision Foundation (CVF) Konferencja na temat widzenia komputerowego i rozpoznawania wzorców (CVPR) w Seattle w stanie Waszyngton.

Badanie to przeprowadzono na Uniwersytet Pensylwanii School of Engineering and Applied Science oraz w Instytucie Sztucznej Inteligencji Allena (AI2).